人工智能范式转变:《苦涩的教训》作者理查德·萨顿对纯粹的大语言模型规模扩展表示怀疑。

人工智能范式转变:《苦涩的教训》作者理查德·萨顿对纯粹的大语言模型规模扩展表示怀疑。

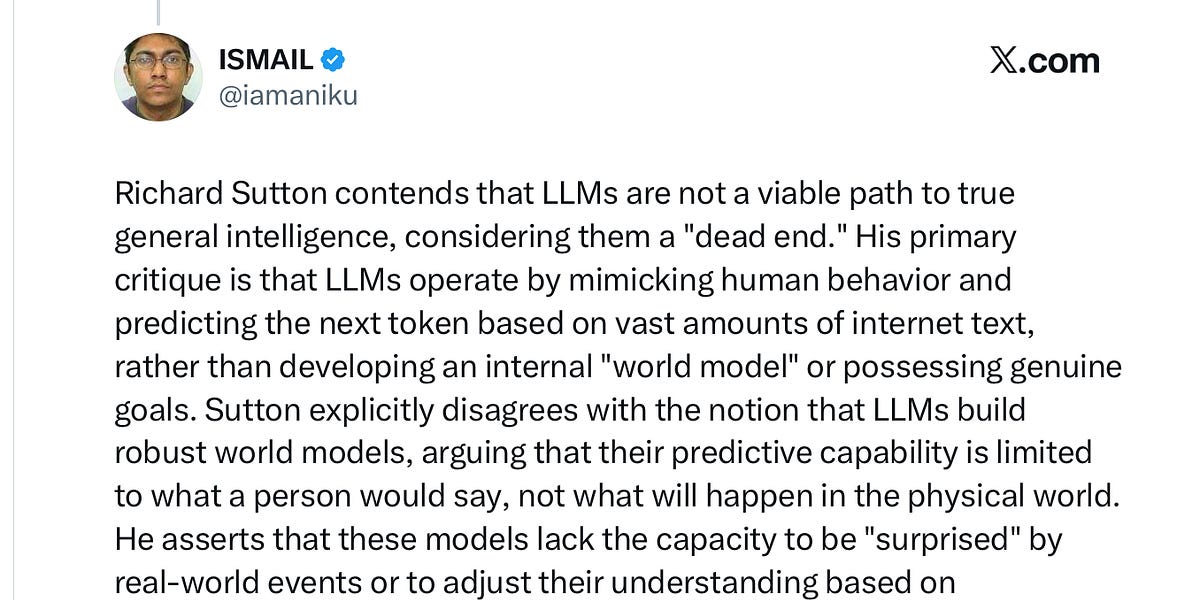

在AI研究领域发生的一项震撼根基的重大进展中,极具影响力的图灵奖得主、2019年广为引用的文章《苦涩的教训》的作者瑞奇·萨顿,似乎已公开转变了他对纯粹大型语言模型(LLMs)未来的立场。萨顿的原始文章,常被解读为AI领域通用方法规模化的号召,曾是主张不断扩大LLM规模的拥护者的理论支柱。

然而,萨顿最近在一个热门播客上发表的评论表明,他已不再对纯粹LLM规模化抱有那种毫无保留的乐观态度。这一转变在AI社区中激起了涟漪,并与包括加里·马库斯在内的知名AI研究人员长期以来的批评不谋而合,马库斯一直坚定地反对将规模化视为通往高级AI的唯一途径。

萨顿的重新评估表明,领先思想家之间正在形成一种共识,即尽管规模化取得了令人瞩目的成果,但它可能并非“你所需要的一切”。这种观点呼应了此前来自扬·勒昆和谷歌DeepMind首席执行官德米斯·哈萨比斯爵士等人物的批评,他们也强调了纯粹预测模型的局限性以及整合“世界模型”和其他架构创新的必要性。

萨顿的这一转变,他曾被视为规模化假设的“守护神”,标志着AI研究的一个潜在转折点,预示着将重新聚焦于混合方法,这种方法结合了通用方法的强大能力与更结构化、神经符号化或基于强化学习的技术,以克服当前LLM固有的局限性。

Read the English version (阅读英文版)

免责声明:本文内容来自互联网公开信息,请仔细甄别,如有侵权请联系我们删除。